Un modèle de classification consiste à détecter et mesurer dans un texte le poids de catégories ayant du sens pour l’analyste : thèmes, sentiments, entités nommées, etc. Certaines catégories sont universelles et s’appliquent à toute analyse, comme par exemple le positif ou le négatif pour la polarité. Mais souvent, l’analyse demande des classifications correspondant à un besoin bien spécifique.

Deux types de modèles : apprentissage machine ou champs lexicaux

Les modèles machine learning traitent des phrases ou des paragraphes en leur attribuant une classe cohérente. Par exemple, la phrase « le défilé de D&G a été un succès pour le nouveau créateur de la marque » sera catégorisé dans la classe « mode » par un analyste humain, et cela même si le mot « mode » n’apparaît pas. En étiquetant quelques centaines d’autres cas entrant dans la catégorie « mode » (ou d’autres), l’analyste humain oriente le modèle de langage vers l’apprentissage des bonnes classes. L’IA apprend ainsi à repérer des ensembles cohérents de mots. Une fois son apprentissage réalisé, le modèle de langage sera en mesure de proposer des classifications, avec des taux d’efficacité de 80% à 99% selon la qualité du modèle sous-jacent, le temps passé ou la complexité de la tâche de classification.

Les modèles topic modeling ou modèles à champs lexicaux traitent des mots ou des expressions. Dans l’exemple précédent, il peut isoler les mots « défilé », « D&G », « créateur ». Eventuellement, plusieurs mots peuvent être rapprochés dans une même classe. On peut imaginer de mettre « créateur » et « couturier » dans une même classe, « D&G » et « Gucci » dans une autre, « défilé » et « mannequin » encore dans une autre, etc.

Le machine learning est inadapté aux contenus de faible volume et aux problématiques à forte diversité

Un modèle machine learning demande une phase d’apprentissage. De quelques centaines à plusieurs milliers d’exemples de phrases (ou paragraphes) sont nécessaires pour apprendre au modèle à détecter la bonne classe. Ensuite, le modèle est capable de généraliser ce qu’il a appris à tout nouvel exemple soumis. Comme cette phase d’apprentissage a un coût non négligeable (humain, machine), le modèle à machine learning est réservé à des volumes de texte importants et récurrents. L’amortissement de la phase de création du modèle n’est en effet envisageable que si le process de traitement de données se traduit par des gains de productivité à la hauteur d’investissements pouvant aller de quelques milliers à dizaines de milliers de d’euros.

Mais parfois, cette méthode n’est pas adaptée. Voici quelques cas :

- le volume de texte est insuffisant (quelques milliers à centaines de milliers de mots) pour envisager d’ « éduquer » une IA,

- les problématiques et donc la fréquence de renouvellement des contenus des textes à analyser est élevée (par exemple, réponses à des enquêtes publiques, analyse de discours de marque, avis de consommateurs sur des produits ou services différents),

- les classes que l’on cherche à détecter dans des contenus textuels changent à chaque mission et sont de nature variable, parfois hyper-précises, parfois très générales.

Dans ces cas, soit une IA n’a pas assez d’exemples pour généraliser correctement, soit il est trop coûteux de faire un apprentissage pour un résultat non ré-utilisable. Le modèle à champs lexicaux et topic modeling sera alors plus simple, plus rapide et nettement moins coûteux.

Quelques bonnes pratiques

Défricher par une analyse automatique. Youmean propose une détection automatique de topiques à champs lexicaux. Cette fonction détecte des ensembles de mots souvent cités ensemble dans le corpus. Purement automatisée, elle offre un résultat partiel à l’analyste dont le besoin de précision est souvent plus élevé. Elle donne néanmoins un premier aperçu des sujets structurant un corpus.

Passer en revue le lexique et les n-grammes. Le moyen le plus rapide de comprendre les sujets d’un contenu est de se pencher sur son lexique (en particulier les substantifs ou noms communs) et ses n-grammes (les expressions récurrentes de la langue). Sur Youmean, un mot peut être dans plusieurs modèles à la fois, cette appartenance est aisée à visualiser et modifier.

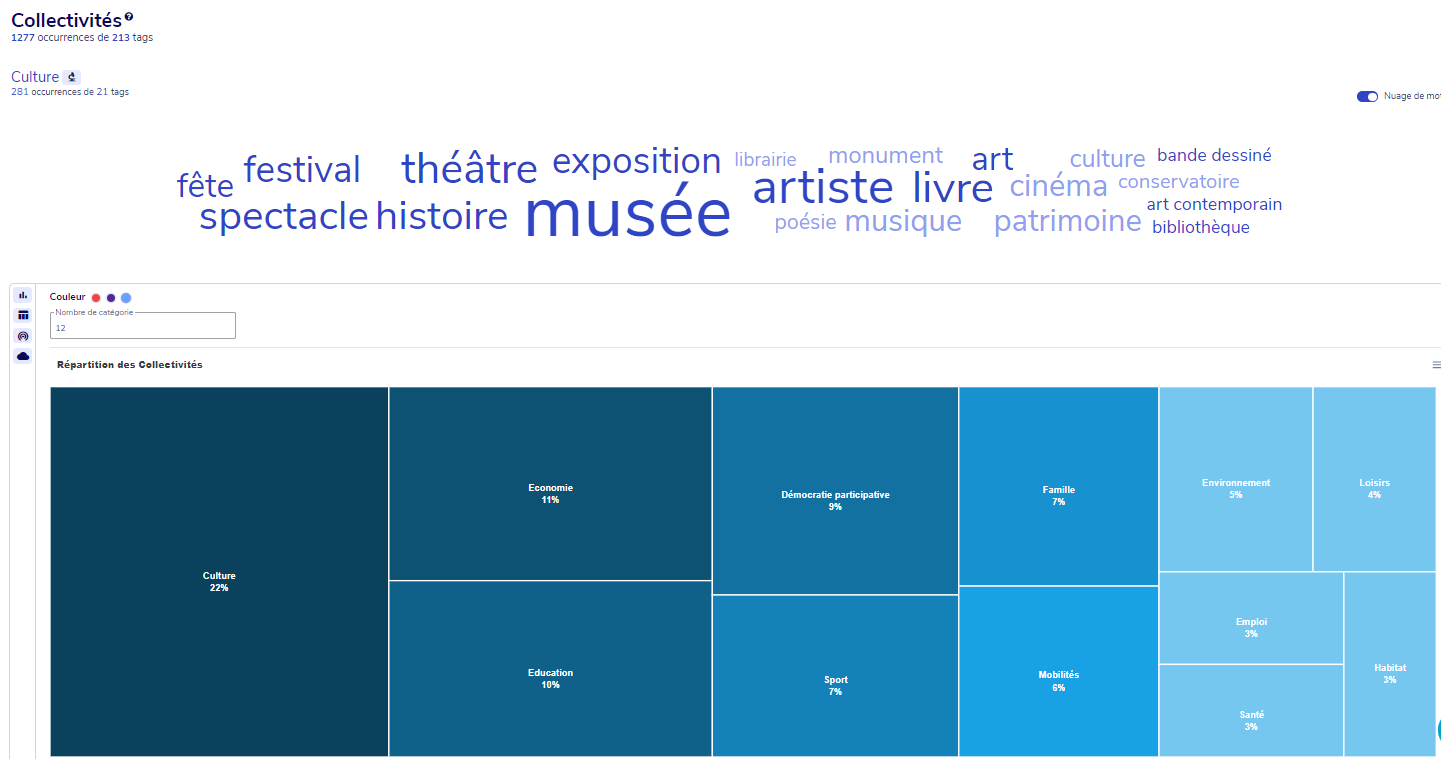

Ne pas comparer des pommes et des bananes. Chaque modèle doit avoir sa cohérence selon l’angle d’analyse choisi et le résultat visé, notamment les graphiques, nuages, courbes qui permettront de synthétiser l’information. Par exemple, si vous voulez examiner un contenu par ses thèmes, vous ne rassemblerez que des thèmes comme champs lexicaux dans un modèle dédié. Si vous voulez plutôt identifier les sentiments exprimés, vous n’isolerez que des sentiments dans un autre modèle. Mélanger les deux approches (thèmes et sentiments) dans un même modèle donnerait une statistique absurde.

Avoir le même niveau de généralité dans la construction des champs. Un modèle à champ lexical peut avoir autant de champs que nécessaire pour comparer leur fréquence. Les champs doivent avoir sensiblement le même périmètre. Par exemple, imaginons que vous vouliez détecter des entités naturelles dans un corpus décrivant les pratiques des habitants dans leurs rapports à la nature. Vous pouvez faire quatre grandes classes « faune », « flore », « fonge », « biotope » qui auront à peu près le même niveau exploratoire. Mais si vous voulez davantage de granularité et que vous distinguez plutôt des familles d’animaux (« mammifères », « oiseaux » etc.), alors il sera préférable de distinguer aussi les composants des autres champs. Ainsi vous conserverez le même niveau de détail dans l’analyse, et ne comparerez pas des petits champs très détaillés avec un grand champ fourre-tout.

Conserver vos modèles. Youmean vous permet de construire dans un projet autant de modèles que vous le souhaitez et de les conserver dans une bibliothèque de modèles mobilisables en permanence pour n’importe lequel de vos projets. Si vous avez des sujets récurrents d’analyse, il sera en effet plus simple de repartir d’un modèle existant quitte à l’affiner encore, l’enrichir ou le modifier à votre convenance.